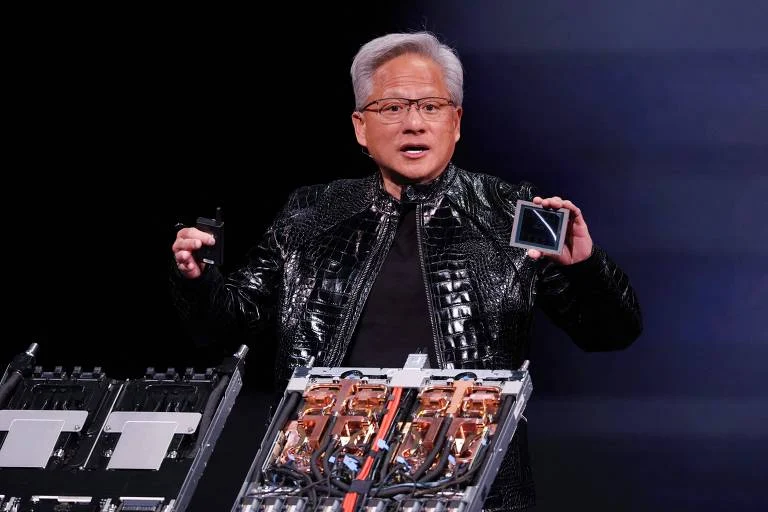

A Nvidia disse que sua próxima geração de chips da Nvidia já está em “plena produção” e que os novos processadores prometem aumentar muito a capacidade de IA das máquinas.

Os futuros chips chegam no final deste ano, e a empresa mostrou como eles podem ser agrupados em “pods” para escalar tarefas de inteligência artificial para milhares de usuários simultâneos.

As informações foram apresentadas na CES em Las Vegas, conforme informação divulgada pela Reuters.

O que é a plataforma Vera Rubin

A plataforma chamada Vera Rubin reúne seis chips separados, segundo os executivos, e inclui um dispositivo principal com 72 unidades gráficas, e 36 novos processadores centrais.

Huang demonstrou também a capacidade de agrupar esses dispositivos em “pods” com mais de 1.000 chips Rubin, uma arquitetura pensada para treinar e servir modelos de IA em grande escala.

Desempenho e o novo formato de dados

Segundo a companhia, os novos chips podem oferecer cinco vezes mais capacidade de computação para funções de IA em comparação com os processadores anteriores da empresa.

Para alcançar esse salto, a Nvidia afirmou que os Rubin usam um tipo proprietário de dados que espera ver adotado pelo setor, e Huang disse, “Foi assim que conseguimos oferecer um aumento tão gigantesco no desempenho, embora tenhamos apenas 1,6 vez o número de transistores”.

Outros anúncios, rede e armazenamento

Além dos chips, a Nvidia apresentou uma nova geração de switches de rede com uma conexão chamada “copackaged optics”, projetada para conectar milhares de máquinas em uma só infraestrutura.

A empresa também adicionou uma camada tecnológica chamada “armazenamento de memória de contexto”, voltada a acelerar respostas de chatbots em conversas longas e em uso por milhões de pessoas ao mesmo tempo.

Modelos abertos e impacto para a indústria

Huang anunciou ainda um modelo de IA automotiva, chamado Alpamayo, e disse que será disponibilizado mais amplamente, junto com os dados usados para treiná-lo, para que montadoras possam avaliar o sistema.

Conforme Huang, “Não apenas abrimos o código-fonte dos modelos, mas também abrimos o código-fonte dos dados que usamos para treinar esses modelos, porque somente dessa forma você pode realmente confiar em como os modelos foram criados”.

O anúncio reforça a estratégia da Nvidia de dominar o treinamento e a entrega de IA, enquanto enfrenta concorrência de empresas como AMD e clientes com capacidade interna, como o Google.